要約

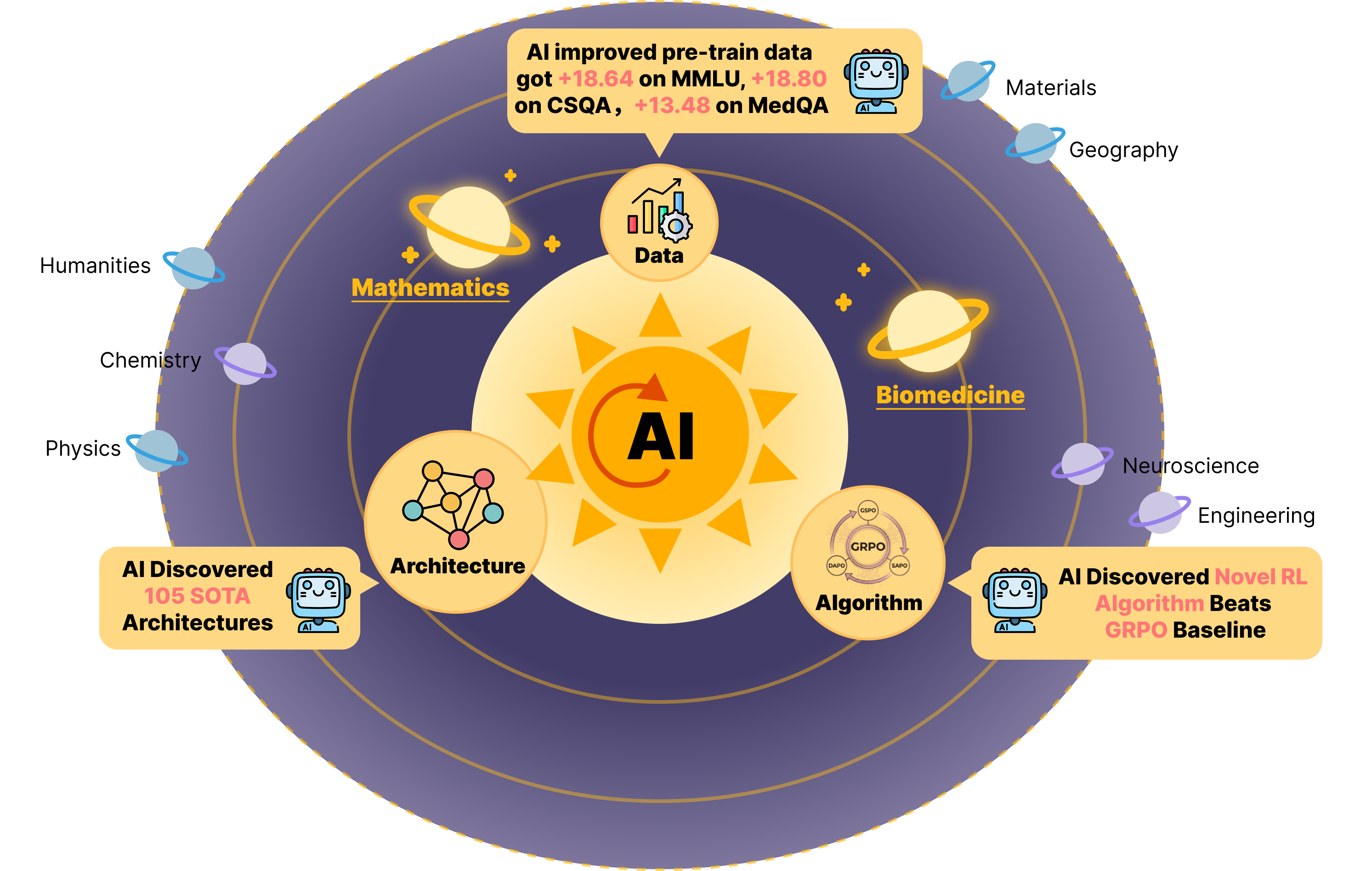

AIはAI自体の開発を加速できるのでしょうか?近年のエージェントシステムは、迅速なフィードバックが得られる明確なタスクにおいて優れた性能を示してきましたが、実際のAIの進歩を牽引するコストのかかる長期的かつ弱い監視下の研究ループを扱えるかどうかは依然として不明です。本稿では、AIのためのAI研究のためのエージェントフレームワーク「ASI-Evolve」を提案します。このフレームワークは、「学習→設計→実験→分析」というサイクルを通じてこのループを完結させます。ASI-Evolveは、標準的な進化的エージェントに2つの重要なコンポーネントを追加します。1つ目は、蓄積された人間の事前知識を各探索ラウンドに注入する「認知ベース」です。2つ目は、複雑な実験結果を将来の反復のための再利用可能な洞察として抽出する専用の「アナライザー」です。私たちの知る限り、ASI-Evolveは、AI開発の3つの中心的な要素(データ、アーキテクチャ、学習アルゴリズム)においてAI主導の発見を実証した最初の統一フレームワークです。ニューラルアーキテクチャ設計では、105のSOTA(最先端)線形アテンションアーキテクチャを発見し、発見された最良のモデルはDeltaNetを+0.97ポイント上回り、近年の人間が設計した改善の約3倍の利得を達成しました。事前学習データのキュレーションでは、進化したパイプラインがベンチマークの平均性能を+3.96ポイント向上させ、MMLUでは18ポイントを超える改善を達成しました。強化学習アルゴリズム設計では、発見されたアルゴリズムはGRPOを上回り、AMC32では+12.5ポイント、AIME24では+11.67ポイント、OlympiadBenchでは+5.04ポイントの向上を示しました。さらに、この「AIのためのAI」というパラダイムが、数学や生物医学といったAIスタックを超えて転移可能であることの初期証拠も提示しています。これらの結果は、ASI-EvolveがAI開発の基礎段階においてAIがAIを加速することを可能にする有望な一歩であり、閉じたループのAI研究の実現可能性を示す初期証拠となることを示唆しています。ASI-Evolveはhttps://github.com/GAIR-NLP/ASI-Evolveで完全にオープンソース化されています。

1. 導入

人工知能(AI)は多くの相互作用する要因によって進歩しますが、「データ、モデルアーキテクチャ、学習アルゴリズム」はその中でも特に中心的な3つの研究要素です。これら各方向の進歩は、仮説生成、実装、実験、分析の反復サイクルに依存しています。しかし、実際にはこれらのサイクルは多次元的な人間のボトルネックによって制約されています。例えば、人間が並行して探索できる仮説空間は極めて限られており、実験ワークフローには多大な人的労力と頻繁な介入が必要であり、反復にわたる洞察の蓄積は個人の経験と直感に依存するため、知識の体系的な保存と移転が困難です。これらの制約はAI開発のペースと規模を根本的に制限し、ある中心的な問いを提起します。「AIはAI自体の開発を加速できるのか?」

近年のAI能力の進歩により、この可能性はますます現実味を帯びています。科学発見におけるAIの役割は急速に進化してきました。AlphaFoldのような専門化されたシステムから、LLMベースのエージェントシステムまで、科学ワークフローを支援する範囲が拡大しています。例えば、SciMasterは科学的質問応答に焦点を当て、ML-MasterやMLEvolveは固定された評価基準の下での最適化問題に取り組み、AI Scientistは研究出版パイプラインを自動化します。AlphaEvolveは、コーディングエージェントを通じて候補解を反復的に改善することで、自律的な科学的最適化に向けた重要な一歩を踏み出しました。しかし、実際のAIの進歩を牽引する研究ループは、自動化が著しく困難です。アーキテクチャ、データパイプライン、学習アルゴリズムの改善には、大規模なコードベースの変更、高価な実験の実行、多次元的な結果の解釈、多くのラウンドにわたる一貫した探索が必要です。既存のフレームワークは、AIがこの領域で統一的に効果的に動作できるか、単一の狭い設定ではなくAI開発の3つの基礎的な柱にわたって意味のある進歩を生み出せるかを実証していません。

このギャップに対処するため、私たちは「AIのためのAI」研究のためのエージェントフレームワーク「ASI-Evolve」を提案します。一般的な科学プロセスは、研究者が広範な背景文献を収集し、情報に基づいた仮説を策定し、実験を実行し、体系的な分析を通じて洞察を抽出するという原則的なサイクルに従います。このワークフローに触発され、ASI-Evolveは「学習→設計→実験→分析」というサイクルを通じて、事前知識、仮説生成、実験実行、反復的精錬の間のループを完結させます。この設計において中心的なのは2つのコンポーネントです。第一に、構造化された「認知ベース」は、各探索ラウンドを蓄積された人間の研究文献に基づかせ、システムがゼロから探索するのではなくドメイン知識の上に構築できるようにします。第二に、専用の「アナライザー」は、複雑な多次元的な実験結果を、将来の反復のために再利用可能な構造化された洞察に変換します。これらのコンポーネントにより、フィードバックが高価で、間接的で、ノイズが多く、解釈が困難な長期的なAI研究タスクにおいて持続的な改善が可能になり、進化プロセスの速度と品質の両方が大幅に向上します。

ASI-Evolveを使用して、AIがその開発スタックの複数の部分を加速できることを実証します。私たちの知る限り、これはAI開発の3つの中心的な要素(データ、アーキテクチャ、学習アルゴリズム)にわたるAI主導の発見の最初の統一的な実証です。(1) モデルアーキテクチャ:ニューラルアーキテクチャ設計において、ASI-Evolveは1,773回の探索ラウンドで1,350の候補を自律的に生成し、人間が設計したDeltaNetを上回る105のアーキテクチャを発見しました。最も性能の良いモデルは+0.97ポイントの利得を達成し、近年の手動SOTA進歩のほぼ3倍です。(2) データキュレーション:事前学習データのキュレーションにおいて、進化した戦略はよりクリーンな学習データセットを生成し、元のデータと比較して平均ベンチマークで3.96ポイント改善しました。特にMMLUのような知識集約型ベンチマークでは18ポイントを超える改善を達成しました。(3) 学習アルゴリズム:強化学習アルゴリズム設計において、このフレームワークは、GRPOベースラインを上回る数学的に妥当な革新的な最適化メカニズムを導き出し、AMC32で+12.5ポイント、AIME24で+11.67ポイント、OlympiadBenchで+5.04ポイントの向上を示しました。これらの結果は、ASI-Evolveフレームワークの下で、AIがAI開発の主要部分(モデルアーキテクチャ設計からデータ準備、学習アルゴリズム開発まで)を加速できることを示しています。

2. 本論文のポイント(予備知識)

本章では、なぜASI-Evolveが必要なのか、既存研究との違いを整理します。科学タスクの難しさを「実行コスト」「探索空間の複雑さ」「フィードバックの複雑さ」の3つの観点から分析します。

ポイント1:科学タスクの難しさを3つの要素で整理

例えば、「円詰め込み問題」というタスクを想像してください。1×1の正方形の中に26個の円を詰め込み、円の半径の合計を最大化する問題です。これは、1回の試行が短時間で終わり、結果も単純な数値で出るため、「実行コスト」と「フィードバックの複雑さ」は低いです。しかし、AI開発の主要タスク(ニューラルアーキテクチャ設計、データ準備、学習アルゴリズム設計)は、全く異なります。

例えば、ニューラルアーキテクチャ設計では、1つの候補を検証するために数十〜数百GPU時間を要し、大規模なコードベースの修正も必要です(実行コストが高い)。設計の選択肢は膨大で、正解が決まっていません(探索空間が複雑)。実験結果は、損失関数の推移や多数のベンチマークスコアなど、多様な信号を含んでおり、単純な数値だけでは判断できません(フィードバックが複雑)。ASI-Evolveは、この「高コスト・広範囲・難解釈」な領域をターゲットとしています。

ポイント2:既存研究との比較

- 科学質問応答(例:GPQA、HLE):既に答えがわかっている質問に答えるタスクです。実験の実行が不要で、評価基準も単純です。ASI-Evolveが対象とするタスクに比べて、タスク長は短いです。

- 構造化タスク実行(例:MLE-bench、SWE-bench):明確な目標(競技のスコア最大化やバグ修正)に向かってコードを最適化するタスクです。探索空間は事前にある程度制約されています。

- 軽量科学発見(例:AlphaEvolve、FunSearch):オープンな発見を目指しますが、1回の試行規模は小さい(単一の関数など)。フィードバックは即座で直接的です。例えばAlphaEvolveは56年ぶりにStrassenの行列乗算アルゴリズムを改善しました。

ポイント3:ASI-Evolveの独自性

ASI-Evolveは、上記の分類の中で最も難易度が高い「大規模科学探索」の領域をターゲットにします。これを実現するための鍵となる2つのコンポーネントが「認知ベース」と「アナライザー」です。

- 認知ベース:人間の事前知識(文献や経験則)をデータベース化し、探索の初期段階から有望な方向を示唆します。ゼロからの再発見を避け、冷起動(探索初期の立ち上がり)を加速します。

- アナライザー:実験の生ログ(学習曲線やエラー詳細)を分析し、「次は何を試すべきか」という要約レポートを作成します。これをデータベースに蓄積することで、次回の探索に活かします。

3. ASI-Evolveの仕組み

ASI-Evolveは、「学習→設計→実験→分析」の4段階を繰り返すパイプラインです。各ラウンドで、システムはデータベースから過去のノード(動機、コード、結果、分析)をサンプリングし、認知ベースから関連知識を検索し、新しい候補プログラムを生成し、実験を実行し、結果を分析してデータベースに戻します。

3.1 リサーチャー(Researcher)

データベースと認知ベースからの情報に基づき、LLM(大規模言語モデル)が次の候補プログラムとその動機を自然言語で生成します。コード全体を書き換えるだけでなく、差分(diff)形式での修正もサポートしており、大規模コードベースの進化に適しています。

3.2 エンジニア(Engineer)

生成されたプログラムを実際の環境で実行し、評価スクリプトを通じて定量評価信号を生成します。実行時間制限や簡易テストによる早期却下機能があり、高コストな実行の前に欠陥のある候補をフィルタリングします。

3.3 アナライザー(Analyzer)

実験から得られた豊富な補助信号(複数のメトリクス、訓練ログ、エラー痕跡)を受け取り、それらを「意思決定指向の報告書」に要約します。この報告書はデータベースに保存され、次回以降のリサーチャーが参照します。文脈の長さを管理可能にしつつ、分析の深さを犠牲にしません。

3.4 認知(Cognition)

タスクに関連するヒューリスティクス、既知の落とし穴、設計原則をエンコードした「認知ベース」を導入します。各ラウンドで、サンプリングされたノードの情報をクエリとして、意味検索(埋め込みベクトル類似度)により関連する認知項目を少数取得し、リサーチャーの文脈に注入します。これにより、有望な方向への探索が加速されます。

3.5 データベース(Database)

システムの永続メモリです。各進化ステップの結果(動機、プログラム、結果、分析、スコア、メタデータ)を「ノード」として保存します。サンプリングアルゴリズムとして、UCB1、ランダム、貪欲法、MAP-Elites(品質と多様性を保持するアーカイブ)をサポートします。

4. 主なタスクと結果

ASI-EvolveをAI開発の3つの主要コンポーネント(モデルアーキテクチャ設計、データ準備、学習アルゴリズム設計)に適用し、その有効性を検証しました。

4.1 シナリオ1:モデルアーキテクチャ設計

タスク設定:線形アテンションメカニズムを用いた効率的なシーケンスモデルの設計を課題としました。DeltaNetをベースラインとし、より性能の良いアテンション層を発見することを目指しました。1回の評価に数時間のGPU学習を要する高コストなタスクです。

方法:認知リポジトリを、線形アテンションや状態空間モデルに関する約100本の論文から抽出した約150エントリで初期化しました。静的チェックエージェント(設計の事前検証)、デバッグエージェント(エラー修正)、新規性チェック(重複除外)を導入し、効率的な探索を支援しました。

結果:1,773回の探索ラウンドを通じて、DeltaNetベースラインを上回る105個のアーキテクチャを発見しました。最良のモデルは、開発ベンチマーク平均で57.28%(DeltaNetは55.76%)、汎化ベンチマークで45.40%(同44.74%)を達成しました。人間が設計した最新SOTA(Mamba2)のDeltaNetに対する改善幅(+0.34ポイント)に対し、ASI-Evolveの発見したモデルはほぼ3倍(+0.97ポイント)の改善を達成しました。

分析:発見されたトップ5アーキテクチャの共通テーマは、「固定割り当て方式から、入力内容に基づいて計算予算を動的に調整する適応的・マルチスケールルーティングへの移行」でした。PathGateFusionNet(階層的ルーティング)、ContentSharpRouter(内容認識ルーティング)、FusionGatedFIRNet(独立シグモイドゲート)など、柔軟な設計が生み出されました。

4.2 シナリオ2:事前学習データのキュレーション

タスク設定:事前学習データの品質を向上させるための、カテゴリ別のキュレーション戦略設計をタスクとしました。戦略空間は膨大で離散的であり、どのような品質問題を優先すべきかも自明ではありません。

方法:各カテゴリからサンプリングしたデータを観察し、品質問題(HTMLタグの混入、不完全な断片、フォーマット不整合など)を認知リポジトリに蓄積しました。各反復で、リサーチャーが候補戦略を生成し、エンジニアがサンプルデータに適用し、アナライザーが品質スコアと診断フィードバックを提供しました。

結果:Nemotron-CCデータセット(672Bトークン)に対する最適化戦略を設計し、Nemotron-CC_ASI+(504Bトークン)を生成しました。3Bパラメータのモデルを500Bトークンで学習させた結果、元データ比で平均ベンチマークスコアを3.96ポイント改善しました。特に知識集約型タスクで大幅な改善を示し、MMLUで+18.64ポイント、CSQAで+18.80ポイント、MedQAで+13.48ポイント向上しました。

分析:発見された戦略は、ターゲットを絞ったノイズ除去、フォーマット正規化、ドメイン固有の保存ルールを一貫して組み合わせていました。AIは、反復的な精錬を通じて、明確な基準と閾値を持つ効果的な戦略に収束しました。

4.3 シナリオ3:強化学習アルゴリズム設計

タスク設定:GRPO(Group Relative Policy Optimization)をベースラインとし、LLM訓練のための新しい強化学習アルゴリズムを設計するタスクです。

方法:GRPO以降の10本の論文を認知リポジトリに追加し、分散低減やKLペナルティ修正の概念を事前に与えました。4Bモデルでの探索フェーズと14Bモデルでの検証フェーズの2段階評価を行いました。

結果:300回の進化ラウンドで、GRPOベースラインを上回る10個のアルゴリズムを発見しました。最良のアルゴリズムは、数学ベンチマークでGRPOに対し、AMC32で+12.5ポイント(67.5→80.0)、AIME24で+11.67ポイント(20.00→31.67)、OlympiadBenchで+5.04ポイント(45.92→50.96)の向上を示しました。

分析:発見されたアルゴリズムには、数学的に妥当な独自のイノベーションが含まれていました。例えば、Algorithm A(Pairwise Asymmetric Optimization)は、グループ平均ではなくペアワイズ報酬差の比較優位推定を導入し、有利/不利に応じてPPOのクリッピング窓を動的に調整する非対称クリッピング機構を持っていました。Algorithm B(Budget-Constrained Dynamic Radius)は、百分位正規化を用い、トークンごとの更新半径をアドバンテージの大きさに反比例して動的に制限し、訓練の安定化を図りました。

5. 実証分析

ASI-Evolveの有効性をより深く理解するため、「円詰め込み問題」という標準ベンチマークタスクでの比較実験、コンポーネントのアブレーション研究(一部を取り除いた実験)、そしてAI/MLスタック以外の領域(創薬)への応用実験を行いました。

5.1 円詰め込み問題でのベンチマーク

タスク:1×1の正方形に26個の円を詰め込み、半径の合計を最大化する問題です。検証コストが低い一方で、非自明なアルゴリズム設計が必要です。

主な結果:ASI-Evolveは、わずか17ステップでSOTAレベル(2.63597)に到達しました。これは、OpenEvolve(460ステップ)やSkyDiscover(89ステップ)と比較しても最速です。

5.2 比較実験

- フレームワーク比較:OpenEvolve、GEPA、ASI-Evolveを同一条件(Qwen3-32Bベースモデル)で比較しました。ASI-Evolveは、他2つよりも高い初期スコアでスタートし、安定して改善を続け、唯一SOTAレベルに到達しました。

- モデル比較:ASI-EvolveをGPT-5-miniとQwen3-32Bで実行しました。異なるモデルでも最終的なスコアは同等レベルに収束し、フレームワークの堅牢性を示しました。

- サンプリングアルゴリズム比較:データベースからの親ノード選択手法として、MAP-Elites、UCB1、ランダムを比較しました。「UCB1」は、認知ベースのガイダンスがあるため多様性維持の必要性が低く、最も高速な収束を示しました。

5.3 アブレーション研究

アナライザーの影響:アナライザーを削除すると、初期スコアは高いものの(認知ベースの効果)、その後の改善が遅く、再現性も低下しました。

認知ベースの影響:認知ベースを削除すると、初期の立ち上がりが遅くなりましたが、十分な試行錯誤を経て最終的には改善しました。認知ベースは「冷起動」を加速するが、長期的な進化能力は維持されることがわかりました。

5.4 創薬タスクへの応用(薬物-ターゲット相互作用予測)

タスク:薬物とタンパク質の結合親和性を予測するタスクです。DrugBANをシードアーキテクチャとし、改良を目指しました。

結果:ASI-Evolveが発見したアーキテクチャは、DrugBANベースラインに対し、BindingDB開発セットで+1.91 AUROCポイント(94.15%→96.06%)の改善を示しました。特に重要なのは、未知の薬物やタンパク質に対する「コールドスタート」汎化性能で、未知薬物に対して+6.94 AUROCポイントという大幅な改善を達成しました。

分析:発見されたアーキテクチャは、Sinkhornアテンション(最適輸送に基づくバランスの取れた注意機構)、ドメイン固有の周辺化、Top-kスパースゲーティングを導入していました。これらは、計算生物学の概念と最適輸送理論を融合させることで生まれたものであり、AIが独自に科学文献を統合してイノベーションを生み出した例と言えます。

6. 結論

本稿では、エージェント進化フレームワーク「ASI-Evolve」を提案しました。構造化された認知ベースと専用のアナライザーを備えることで、システムは迅速な冷起動と持続的な改善を達成し、確実にSOTAレベルの結果に到達します。私たちは、AIがAI開発の3つの中心的段階(モデルアーキテクチャ、データ、アルゴリズム)それぞれにおいて、その開発パイプラインを加速できることを実証しました。さらに、AIによって設計されたモデルが、AI/MLスタックを超えた実世界タスク(創薬)でも有効であることを示しました。将来において、AIの自己加速の範囲は、モデルの自力改善から、AI分野全体の自己進化へと広がっていくことが期待されます。