TurboQuant:極限の圧縮技術でAIの効率性を再定義

2026年3月24日

アミール・ザンディエ(Amir Zandieh、研究科学者)とヴァハブ・ミロクニ(Vahab Mirrokni、VP兼Googleフェロー)、Google Research

大規模言語モデルやベクトル検索エンジンのための大規模圧縮を実現する、理論的に裏付けられた高度な量子化アルゴリズム群を紹介します。

関連リンク:TurboQuant、Quantized Johnson-Lindenstrauss、PolarQuant

ベクトルは、AIモデルが情報を理解し処理するための基本的な方法です。小さなベクトルはグラフ上の点などの単純な属性を表現し、「高次元」のベクトルは画像の特徴、単語の意味、データセットの特性などの複雑な情報を捉えます。高次元ベクトルは非常に強力ですが、大量のメモリを消費し、キーバリューキャッシュのボトルネックを引き起こします。これは、頻繁に使用される情報を単純なラベルの下に保存して、コンピューターが遅い巨大データベースを検索せずに即座に取得できる高速の「デジタル備忘録」です。

ベクトル量子化は、高次元ベクトルのサイズを縮小する強力な古典的なデータ圧縮技術です。この最適化はAIの2つの重要な側面に対応します。1つ目は、大規模AIや検索エンジンを支える高速技術であるベクトル検索を強化し、高速な類似性検索を可能にすること。2つ目は、キーとバリューのサイズを縮小し、高速な類似性検索とメモリコスト削減を実現することで、キーバリューキャッシュのボトルネックを解消することです。ただし、従来のベクトル量子化は通常、独自の「メモリオーバーヘッド」をもたらします。ほとんどの手法は、データの小さなブロックごとに量子化定数を(完全な精度で)計算して保存する必要があるためです。このオーバーヘッドは数値ごとに1~2ビット以上追加され、ベクトル量子化の目的を部分的に損なう可能性があります。

本日、ベクトル量子化におけるメモリオーバーヘッドの課題に最適に対応する圧縮アルゴリズムであるTurboQuant(ICLR 2026で発表予定)を紹介します。また、TurboQuantがその結果を達成するために使用するQuantized Johnson-Lindenstrauss(QJL)およびPolarQuant(AISTATS 2026で発表予定)も紹介します。テストの結果、これら3つの技術はすべて、AIモデルの性能を損なうことなくキーバリューのボトルネックを削減できるという大きな可能性を示しました。これは、検索やAIの分野を含む、圧縮に依存するすべてのユースケースに対して、潜在的に深遠な影響を与える可能性があります。

TurboQuantの仕組み

TurboQuantは、精度の損失ゼロでモデルサイズを大幅に削減する圧縮手法であり、キーバリュー(KV)キャッシュの圧縮とベクトル検索の両方をサポートするのに最適です。これは2つの主要ステップによって実現されます。

1. 高品質な圧縮(PolarQuant方式):TurboQuantはまず、データベクトルをランダムに回転させます。この巧妙なステップにより、データの幾何学的構造が簡略化され、標準的で高品質な量子化器(厳密な小数のような連続値の大きな集合を、整数のようなより小さな離散集合の記号や数値にマッピングするツール。音声量子化やJPEG圧縮などが例)をベクトルの各部分に個別に適用しやすくなります。この第1段階は、元のベクトルの主要な概念と強度を捉えるために、ほとんどの圧縮能力(ビットの大部分)を使用します。

2. 隠れた誤差の除去:TurboQuantは、わずかな残りの圧縮能力(たった1ビット)を使用して、第1段階で残ったわずかな誤差に対してQJLアルゴリズムを適用します。QJL段階は、バイアスを除去する数学的な誤差チェッカーとして機能し、より正確なアテンションスコアにつながります。

TurboQuantがこの効率性を実現する仕組みを完全に理解するためには、QJLおよびPolarQuantアルゴリズムの動作について詳しく見ていきます。

QJL:ゼロオーバーヘッドの1ビット技法

QJLは、Johnson-Lindenstrauss変換と呼ばれる数学的手法を使用して、複雑な高次元データを縮小し、データポイント間の基本的な距離と関係性を維持します。結果として得られる各ベクトル数値を、単一の符号ビット(+1または-1)に縮小します。このアルゴリズムは、基本的にメモリオーバーヘッドゼロを必要とする高速の略記法を作成します。精度を維持するため、QJLは高精度のクエリと低精度の簡略化されたデータを戦略的にバランスさせる特殊な推定器を使用します。これにより、モデルはアテンションスコア(入力のどの部分が重要で、どの部分を安全に無視できるかを決定するために使用されるプロセス)を正確に計算できます。

PolarQuant:圧縮への新たな「角度」

PolarQuantは、まったく異なるアプローチを用いてメモリオーバーヘッド問題に対処します。各軸に沿った距離を示す標準的な座標(つまりX、Y、Z)を使用してメモリベクトルを見るのではなく、PolarQuantは直交座標系を使用してベクトルを極座標に変換します。これは、「東へ3ブロック、北へ4ブロック進む」の代わりに「37度の角度で合計5ブロック進む」と言い換えるのに似ています。これにより2つの情報が得られます。コアデータの強度を示す半径(radius)と、データの方向や意味を示す角度です。角度のパターンは既知で高度に集中しているため、モデルは高価なデータ正規化ステップを実行する必要がなくなります。これは、境界が常に変化する「四角い」グリッドではなく、境界が既知の固定された予測可能な「円形」グリッドにデータをマッピングするためです。このため、PolarQuantは従来の方法が担う必要があるメモリオーバーヘッドを除去できます。

PolarQuantは高効率の圧縮ブリッジとして機能し、直交入力を保存および処理のためのコンパクトなPolar「略記法」に変換します。このメカニズムは、d次元ベクトルから座標のペアをグループ化し、極座標系にマッピングすることから始まります。次に半径は再帰的な極座標変換のためにペアで収集されます。これは、データが単一の最終的な半径と説明的な角度の集合に蒸留されるまで繰り返されるプロセスです。

実験と結果

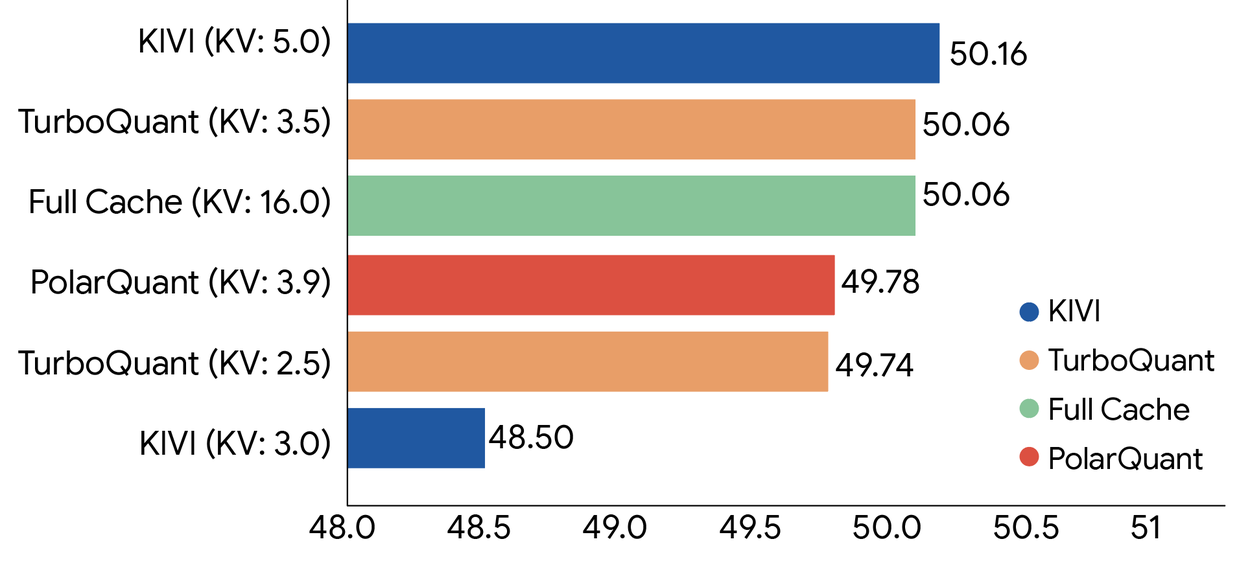

3つのアルゴリズムすべてを、LongBench、Needle In A Haystack、ZeroSCROLLS、RULER、L-Evalなどの標準的な長文脈ベンチマークで厳密に評価しました。評価にはオープンソースのLLM(GemmaおよびMistral)を使用しています。実験データは、TurboQuantがドット積の歪みと再現率の両方で最適なスコアリング性能を達成し、同時にキーバリュー(KV)メモリフットプリントを最小化することを示しています。以下のグラフは、TurboQuant、PolarQuant、およびKIVIベースラインの多様なタスク(質問応答、コード生成、要約を含む)における集計された性能スコアを示しています。

TurboQuantは、LongBenchベンチマークにおいて、さまざまな圧縮手法と比較して堅牢なKVキャッシュ圧縮性能を示しています。Llama-3.1-8B-Instructモデルで評価(ビット幅は括弧内に示されています)。

長文脈の「干し草の中の針(needle-in-haystack)」タスク(つまり、大量のテキスト内に埋もれた特定の小さな情報片をモデルが見つけられるかどうかをテストするためのテスト)の結果を以下に示します。ここでも、TurboQuantはすべてのベンチマークで完璧なダウンストリーム結果を達成し、キーバリューのメモリサイズを少なくとも6倍削減しています。PolarQuantもこのタスクでほぼ損失がありません。

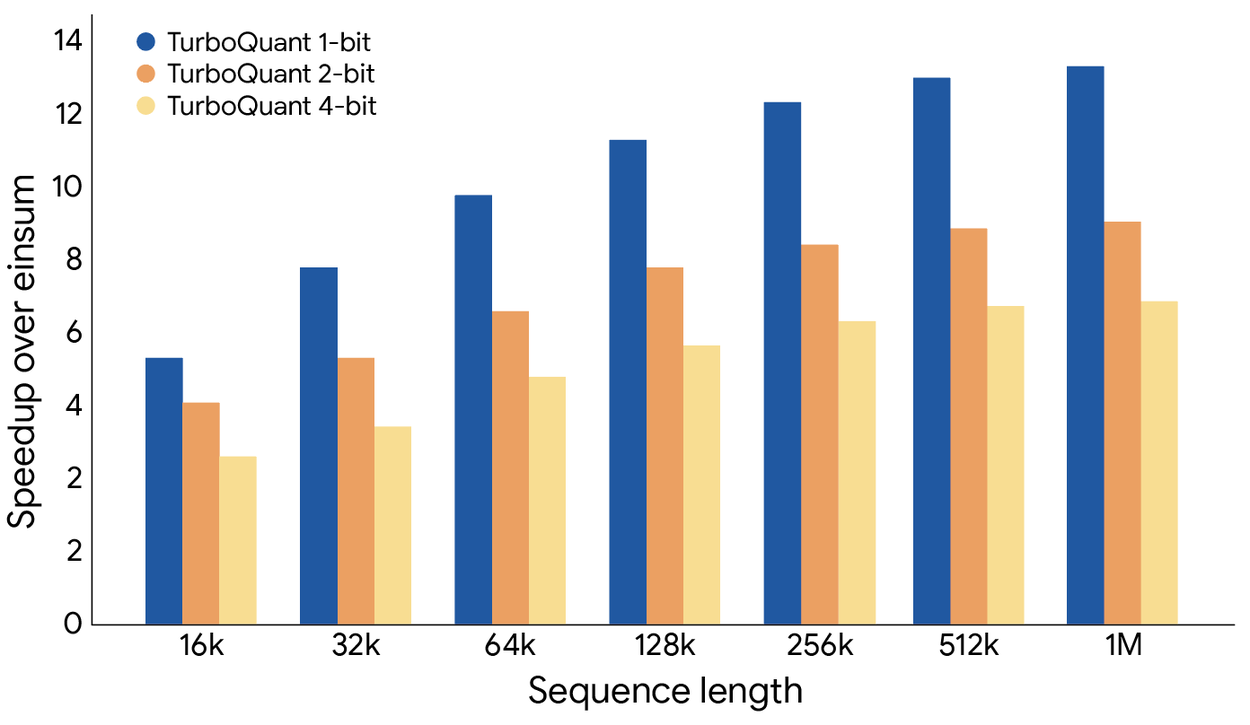

TurboQuantは、学習やファインチューニングを必要とせず、モデルの精度を損なうことなく、キーバリューキャッシュをわずか3ビットに量子化できることを証明しました。しかも元のLLM(GemmaおよびMistral)よりも高速なランタイムを実現しています。これは実装が非常に効率的で、無視できるほどのランタイムオーバーヘッドしか発生しません。以下のプロットは、TurboQuantを使用してアテンションロジットを計算する際の高速化を示しています。具体的には、H100 GPUアクセラレータ上で、4ビットのTurboQuantは32ビットの非量子化キーに対して最大8倍の性能向上を達成しています。

TurboQuantは、さまざまなビット幅レベルでキーバリューキャッシュ内のアテンションロジットを計算する際の大幅な性能向上を示しており、高度に最適化されたJAXベースラインに対して測定されています。

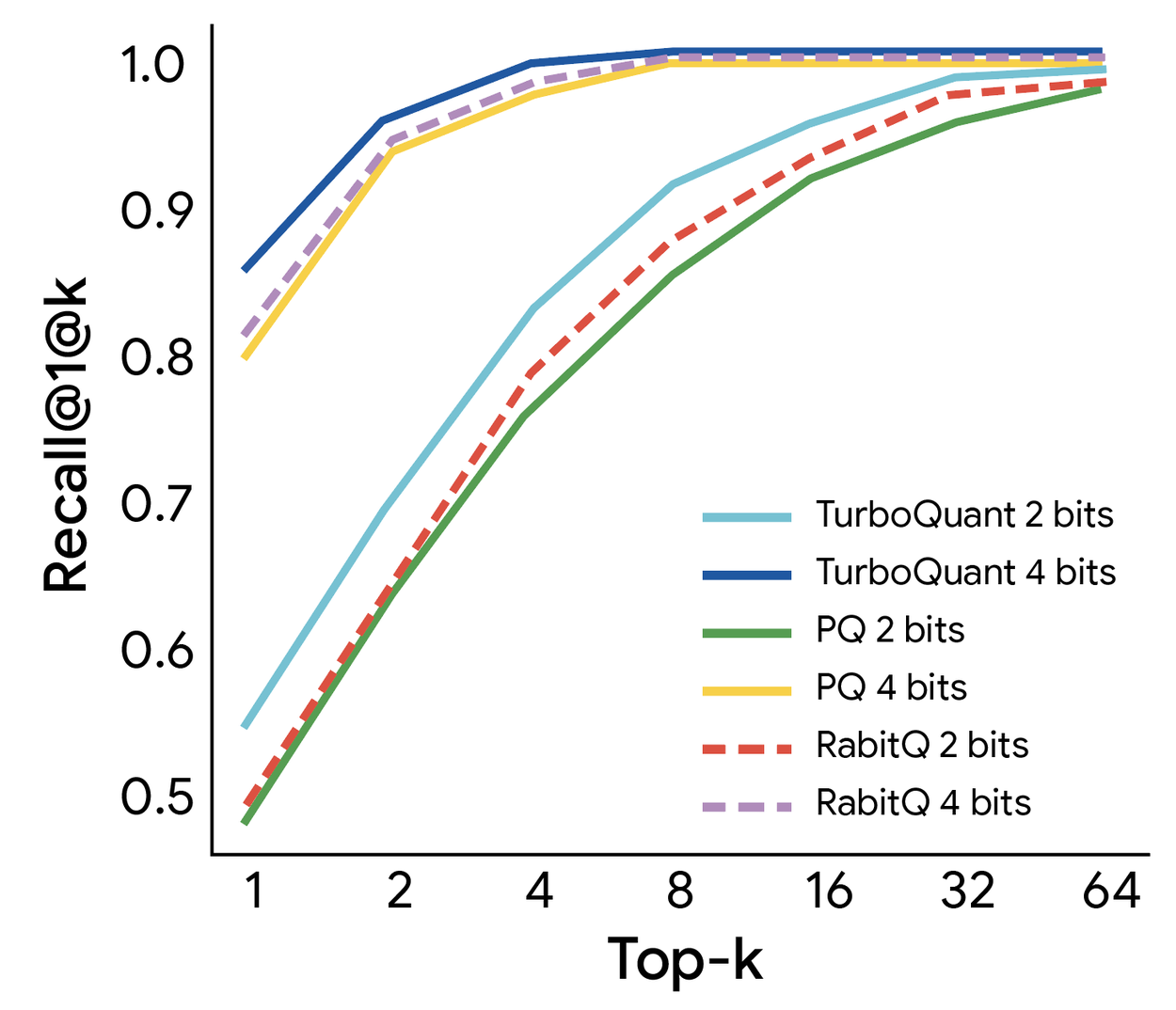

これにより、インデックス構築プロセスを劇的に高速化するベクトル検索などのユースケースのサポートに最適です。TurboQuantの高次元ベクトル検索における有効性を、最先端の手法(PQおよびRabbiQ)と比較して評価しました。評価には、アルゴリズムがトップkの近似内で真のトップ内積結果を捉える頻度を測定する1@k再現率を使用しました。TurboQuantは、非効率な大規模コードブックとデータセット固有のチューニングを利用しているこれらのベースライン手法と比較して、常に優れた再現率を達成しています(下図)。これは、高次元検索タスクにおけるTurboQuantの堅牢性と効率性を確認するものです。

TurboQuantは堅牢な検索性能を示し、GloVeデータセット(d=200)において、さまざまな最先端の量子化ベースラインに対して最適な1@k再現率を達成しています。

TurboQuantは、高次元検索における変革的なシフトを示しています。達成可能な速度の新たなベンチマークを設定し、データ不可知的方式でほぼ最適な歪み率を提供します。これにより、私たちの最近傍エンジンは、はるかに重いモデルの精度を維持しながら、3ビットシステムの効率性で動作できるようになります。詳細は論文を参照してください。

今後の展望

TurboQuant、QJL、およびPolarQuantは、単なる実用的な工学ソリューションではなく、強力な理論的証明に裏付けられた基本的なアルゴリズムの貢献です。これらの手法は、実世界のアプリケーションで優れた性能を発揮するだけでなく、証明可能に効率的であり、理論的下限値の近くで動作します。この厳密な基盤こそが、これらの手法を重要な大規模システムにとって堅牢で信頼できるものにしています。

Geminiのようなモデルのキーバリューキャッシュボトルネックを解決することは重要な応用例ですが、効率的なオンライン・ベクトル量子化の影響はさらに広がります。例えば、現代の検索はキーワードだけでなく、意図や意味を理解する方向へと進化しています。これにはベクトル検索、つまり数十億のベクトルのデータベースから「最も近い」または意味的に最も類似したアイテムを見つける能力が必要です。

TurboQuantのような技術は、この目標にとって極めて重要です。これらは、最小限のメモリ、ほぼゼロの前処理時間、かつ最先端の精度で大規模なベクトルインデックスの構築とクエリを可能にします。これにより、Googleの規模での意味的検索がより高速かつ効率的になります。LLMから意味的検索まで、AIがすべての製品に統合されるにつれて、基本的なベクトル量子化におけるこの取り組みは、これまで以上に重要になります。

謝辞

本研究ラインは、Googleの研究者であるPraneeth Kacham、KAISTの助理教授であるInsu Han、NYUの博士課程学生であるMajid Daliri、Googleの研究者であるLars Gottesbüren、およびGoogleの研究者であるRajesh Jayaramとの共同研究として遂行されました。