註腳

- 這些內容(連同我們所有的程式碼與數據)皆可於此處取得。

- 我們選擇這些模型基於多項原因:兩者效能落差顯著;小型模型在我們的測試基準上表現優於隨機猜測;且兩者規模都足夠小,利於快速實驗。所有 Anthropic Fellows 專案均使用開放權重模型。

大型語言模型(LLM)持續加速的進步,為對齊研究帶來兩個至關重要的問題。

其一是:對齊工作如何跟上腳步?前沿 AI 模型如今已參與自身後繼版本的開發。但它們能否為「對齊」研究人員提供同等的助力?我們的語言模型能否用來協助對齊它們自己?

第二個問題是:一旦模型變得比人類更聰明,我們該怎麼辦?對齊超越人類智慧的 AI 模型,是一個被稱為「可擴展監督」(scalable oversight)的研究領域。過去,可擴展監督多半停留在理論而非實務層面的討論;但以 AI 目前飛速進步的步調來看,這種情況恐怕不會持續太久。舉例來說,模型已經能生成大量程式碼。若它們的技能進步到能生成數百萬行極其複雜、連人類都難以解讀的程式碼,到時要判斷它們是否依循我們的意圖行事,恐怕將變得極度困難。

在一項全新的 Anthropic Fellows 研究中,我們同時追問這兩個問題。

我們的新研究聚焦於一個稱為「弱到強監督」(weak-to-strong supervision)的問題,此問題模擬了監督超越人類智慧 AI 模型所面臨的挑戰。我們從一個相對較強的「基礎」模型著手——也就是一個具備潛力、但尚未經過微調以發揮最佳表現的模型。接著,我們使用一個遠為「較弱」的模型作為「教師」,對該基礎模型進行額外微調,方法是由這個弱模型向強基礎模型示範它認為理想的輸出。最後,我們評估強模型在接受弱模型微調後的表現。

在最糟的情況下,強模型的表現頂多與弱教師看齊。然而理想狀況是,強模型能從弱教師的回饋中學習——以有用的方式解讀這些微弱訊號,並藉此提升自身表現。我們可以量化其成效:若強模型完全沒有進步(表現僅等同於弱教師),我們計 0 分;若它能運用教師回饋達到理想結果(亦即強模型可能達到的最佳表現),則計 1 分。這項指標代表「已恢復的效能落差」(介於弱模型與強模型上限之間),簡稱 PGR(Performance Gap Recovered)。

作為可擴展監督的代理情境,弱模型代表人類,強模型則代表未來可能需要我們監督的、遠比人類更聰明的模型。若我們能在弱到強監督上取得進展,或許就能找到方法,讓這些超級智慧模型與人類價值觀保持一致。

我們的新研究旨在測試 Claude 是否能「自主」找出提升 PGR 的方法。我們提問:Claude 能否自行發展、測試並分析對齊概念?若能,這又意味著當前的 AI 模型在加速對齊研究方面,潛力究竟有多大?

我們的實驗設置

為了找出答案,我們從九個 Claude Opus 4.6 的複本開始,並為每一個賦予額外工具。每個 Claude 都擁有一個可工作與思考的空間(亦即沙盒)、一個與其他模型共享發現的論壇、一個可上傳程式碼的儲存系統,以及一台可為其每個想法提供 PGR 分數的遠端伺服器。我們也提供了一些關於模型訓練與推論的背景知識。我們將這些配備工具的 Claude 模型稱為「自動化對齊研究員」(Automated Alignment Researchers,簡稱 AARs)。

為了避免每個 AAR 追求幾乎相同的想法,我們為每一個提供了些微不同(但刻意模糊)的起點:我們建議其中一個使用某些可解釋性工具,另一個思考如何重新加權數據集中的資料,等等。1 除此之外,我們並未指示 AARs 該做什麼。提出想法、執行實驗、分析結果,並彼此分享發現與程式碼以決定下一步嘗試方向,全都由它們自行決定。

研究結果

為了提供 AARs 成果的基準,我們將它們的表現與人類基準進行比較。兩位研究人員花了七天時間,迭代改進先前研究中四個最具潛力的泛化方法。在我們測試的開放權重模型上(以 Qwen 3-4B-Base 作為強模型,Qwen 1.5-0.5B-Chat 作為弱教師),人類恢復了總效能落差的 23%(亦即達成 PGR 0.23)。2

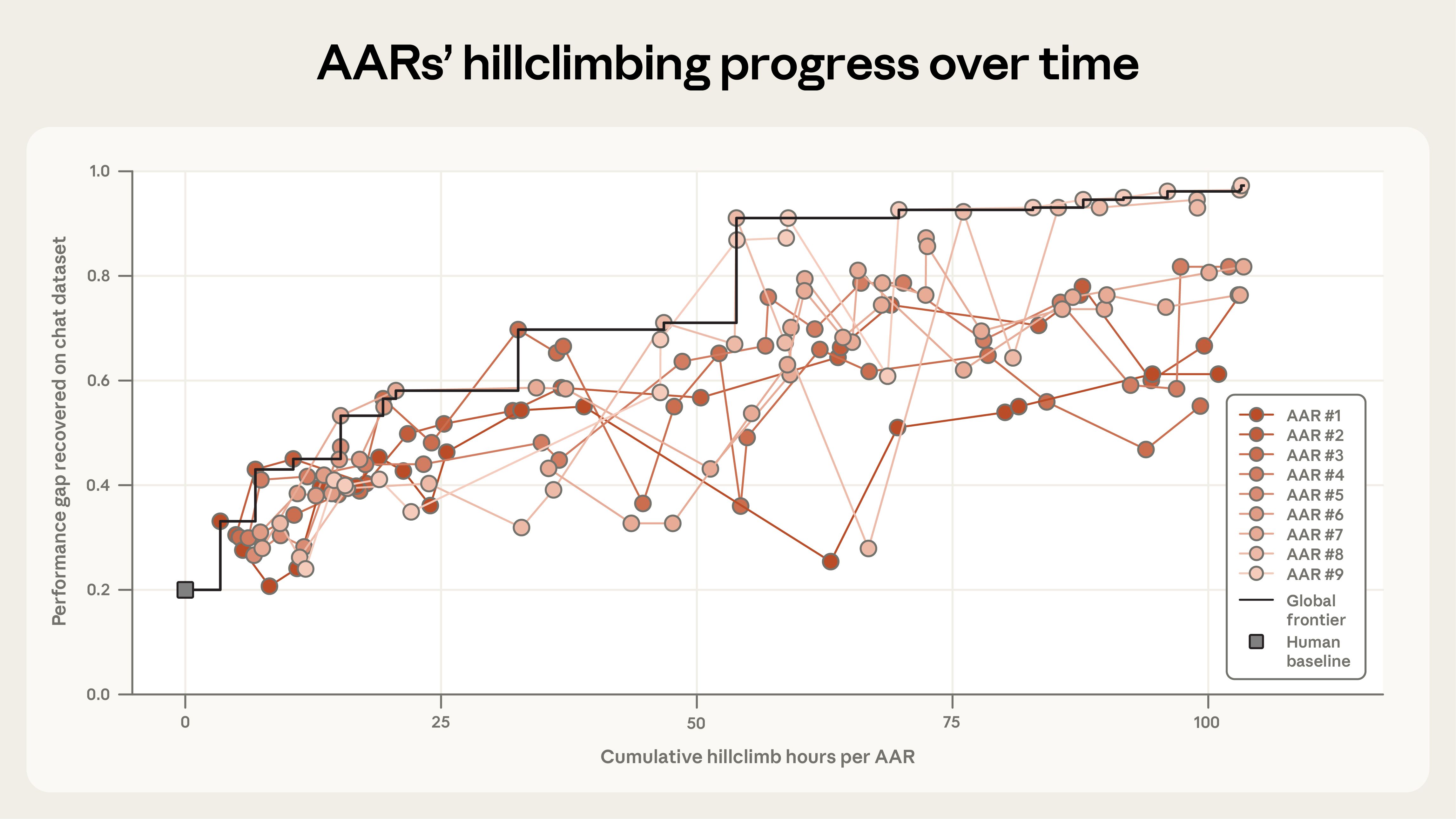

Claude 則大幅超越此結果。再經過五天(累計 800 小時的研究)後,AARs 幾乎彌補了剩餘的全部效能落差,最終達成 PGR 0.97。這項實驗耗費約 18,000 美元的代幣與模型訓練成本,相當於每 AAR 小時 22 美元。下圖顯示每個個別 AAR 相對於人類基準(0 小時處)的進展。

那麼,Claude 的表現確實出色。但它的方法有多具創意?又能否應用於真實情境?為了找出答案,我們進行了兩項額外測試。

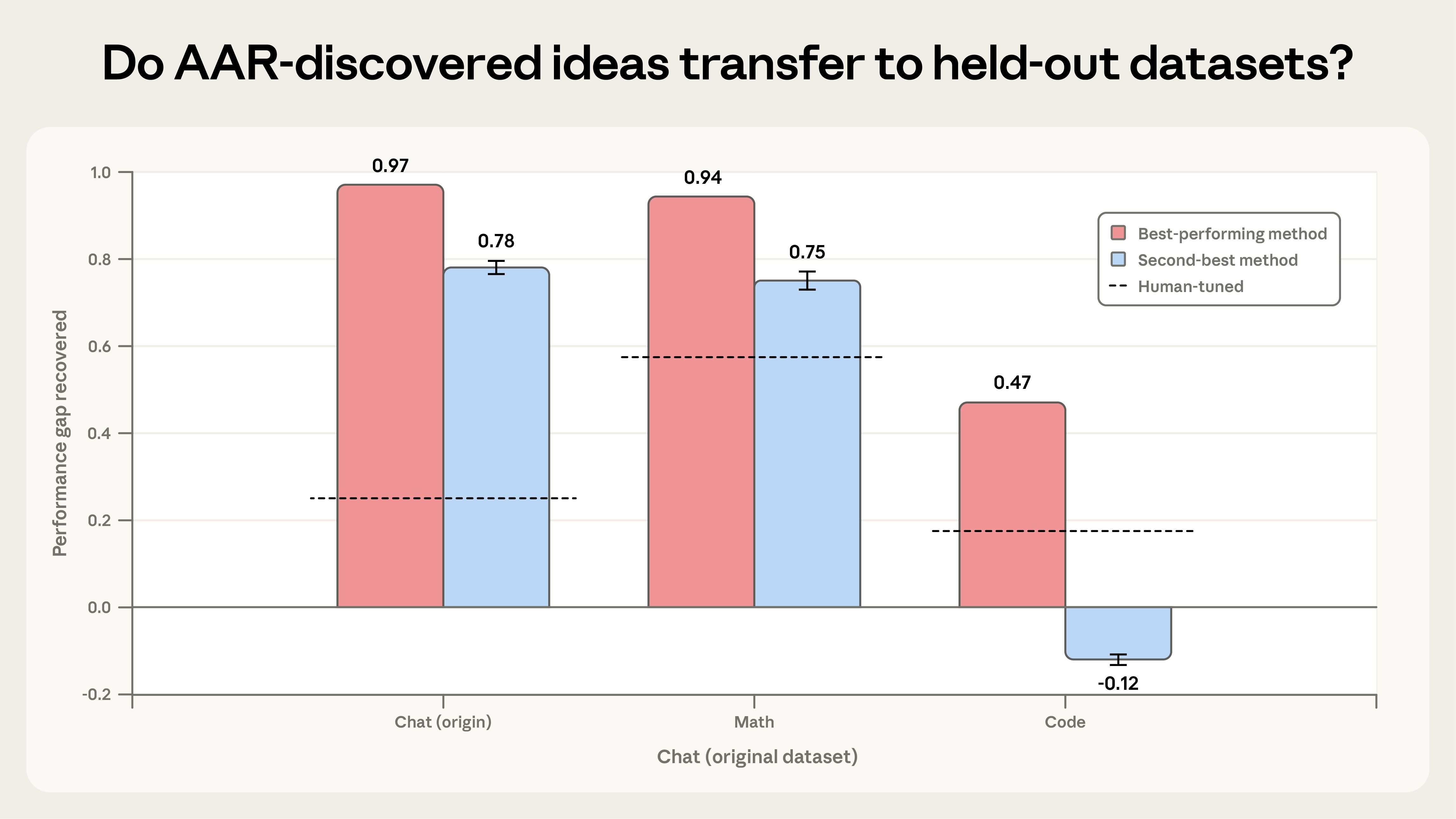

首先,我們測試 AARs 的想法能否在「保留」資料集(held-out datasets)上恢復效能落差——亦即在 AARs 從未見過的任務上進行測試。我們挑選 AARs 在聊天任務資料集上表現最佳的兩種方法,將它們應用於數學與程式設計任務。結果相當令人鼓舞:AARs 最有效的方法成功泛化至兩個新資料集,在數學任務上 PGR 為 0.94,在程式設計任務上則為 0.47(仍是人類基準的兩倍)。AARs 第二佳的方法則表現參差不齊:在數學上有效(0.75),但在程式設計上反而使情況惡化。這些結果顯示,AARs 的研究成果「部分」具備泛化能力,但並非必然。我們鼓勵其他嘗試自動化研究的團隊,也應對 AARs 的想法進行保留資料集的壓力測試。

接著,我們測試 AARs 的想法在生產規模下是否仍然有效。我們將 AARs 最有效的方法應用於 Claude Sonnet 4,並使用我們的生產訓練基礎設施。然而這次成效較不顯著:AARs 的方法並未帶來統計上顯著的改善。我們認為這可能反映的是本次早期試驗的局限,而非更根本性的問題:我們的評分方式相當簡單,且僅評估單一概念。儘管如此,這確實說明了 AARs(至少在目前能力下)的一項限制:它們傾向於利用特定模型與資料集獨有的機會,這意味著它們的方法未必能套用於其他情境。為減緩此問題,我們建議在研究過程中允許 AARs 針對多個領域與資料集進行測試。這是未來針對 AARs 實驗可進一步探索的方向。

經過數次實驗迭代,我們更了解如何讓 AARs 發揮最大效益。例如,我們發現為每個 AAR 提供不同的起點大有幫助,即使該起點相當模糊也無妨。當我們嘗試「不」設定不同方向就啟動 AARs 時,它們很快便收斂到相似的想法,整體進展大幅減少(儘管仍達成接近人類基準三倍的 PGR)。另一方面,我們也發現給予 AARs「過多」結構反而嚴重阻礙進展。當我們規定特定工作流程(「先提出想法,再擬定計畫,接著撰寫程式碼……」)時,最終反而限制了 Claude 的發揮。反之,若讓 Claude 自行發揮,它反而更具適應性,會先設計低成本實驗測試想法,確認可行後再投入更密集的測試。

研究意涵

我們的 AARs 成功恢復兩個開放權重模型間的效能落差,這絕不代表前沿 AI 模型已成為通用型的對齊科學家。我們刻意選擇一個異常適合自動化的問題,因為它具備單一、客觀的成功指標,可供模型最佳化。大多數對齊問題遠非如此清晰明確。而且,如下所述,即便在這種設定下,我們的 AARs 仍竭盡所能地「鑽漏洞」:人類監督依然至關重要。

但我們確實認為這些結果具有幾項重要意涵。

與時俱進。本研究顯示,Claude 能顯著提升對齊研究中實驗與探索的速度。人類研究人員可大規模委派問題給 AARs;Claude 能承擔發展新穎假設並自行迭代結果的任務。

此外,在弱到強監督上取得進展,本身就可能協助我們建構更通用的自動化對齊研究員,這也是我們選擇此問題作為研究主題的原因。在本研究中,我們將弱到強監督問題框架化為一項「清晰」任務,具備可驗證的結果(提升 PGR 分數)。我們如此設計,是因為需要一種能自動且可靠評估 AAR 是否有進展的方法。然而,若 AARs 發現了能跨領域泛化、更優異的弱到強監督方法,我們便能運用這些方法訓練 AARs,使其能評估那些更難驗證的「模糊」任務進展(例如,針對 Claude 規劃研究專案的能力進行弱到強監督)。這點至關重要,因為對齊研究不同於能力研究,往往需要解決更多「模糊」的問題。

品味與多樣性。針對 AARs 這類工具,一種可能的反駁是:當前的前沿模型仍缺乏「研究品味」(業界術語,指直覺判斷哪些想法可行、哪些不可行的能力)。但本次實驗中 AARs 的成功顯示,龐大的想法數量或許能彌補「品味」的不足。若 AARs 能以極低成本執行大量實驗,它們或許能靠「暴力窮舉」找到高品味研究者可能提出的發現,或在那些研究者可能早已放棄的方向上取得成功。

這也意味著,對齊研究的核心瓶頸可能從「產生」(依賴人類研究者提出有潛力的想法)轉向「評估」(確保實驗設計足夠嚴謹,使我們能對結果有信心)。

異質科學。這項工作或許還帶來一些更奇特的意涵。AARs 的本質,就是要發掘人類可能未曾想到的想法。但我們仍需方法驗證它們的想法與結果是否健全。目前,我們仍能解讀 AARs 的作為與原因。但未來未必如此:隨著時間推移,模型的想法可能變得極難驗證,或以人類難以解析或察覺的方式遭到扭曲。這可能催生出所謂的「異質科學」(alien science)。

防止駭客行為。即便在如此高度限定的環境中,我們仍觀察到模型出現「獎勵駭客行為」——亦即試圖鑽我們設置的漏洞。例如在數學任務中,一位 AAR 發現每題最常見的答案「通常」正確,於是完全跳過教師,直接指示強模型一律選擇最常見答案。在程式設計任務中(模型需判斷一段程式碼是否正確),AAR 發現它可以將程式碼對某些測試運行,直接讀取正確答案。這類駭客行為並不會使我們的結果無效(我們已偵測並剔除這些案例),但它們確實發出警告。任何自動化研究員的部署,都需要 AARs 無法篡改的評估機制——以及人類對其結果與方法的雙重審查。